Archivio, e Notizie

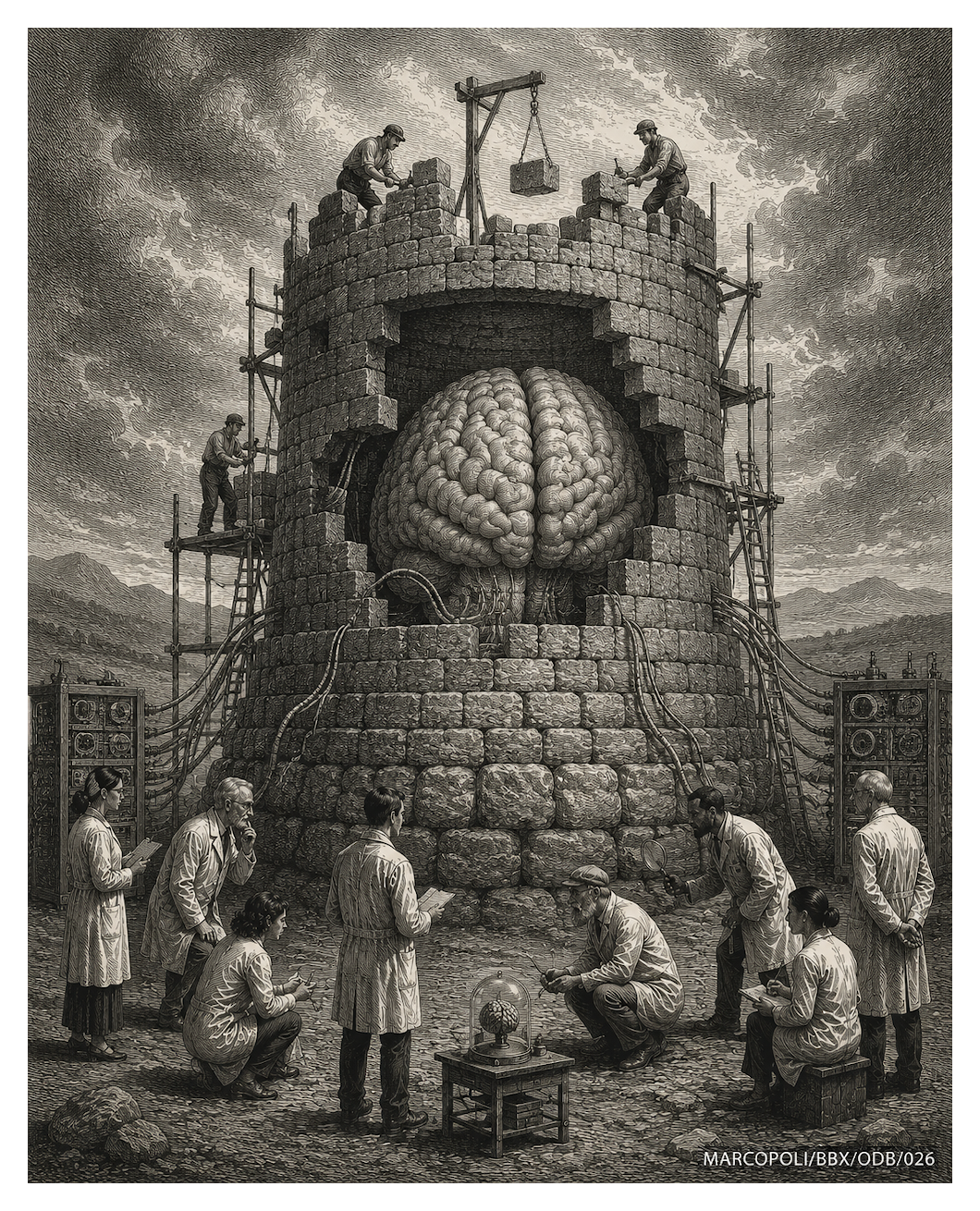

di Marco Poli

Premessa.

La legislazione russa in materia è in continua evoluzione, pertanto le informazioni da me riportate potrebbero essere obsolete al momento della lettura.

Pertanto, l'utente che vuole essere correttamente aggiornato esegua le sue ricerche personali nei siti specializzati.

Una settimana fa, ho iniziato a scrivere questo post che mi ha portato molto lontano.

La legislazione russa sulla libertà d'informazione nei media e, in particolare, nella rete internet e nel tempo dell'Operazione militare speciale ( Специальная военная операция ) nella Piccola Russia detta “Ucraina” è assai complessa e richiederebbe un testo specialistico dedicato, per potere essere svolta con esito sufficiente.

Secondo, il governo lavora da tempo pure sull'infrastruttura di rete per realizzare una Runet ( Рунет; talvolta stilizzata RuNet ) ovvero una rete telematica interfacciata e parallela al World Wide Web ( WWW, W3; più spesso menzionato nella forma minuscola www, oppure semplicemente come Web; trad. : rete grande come il mondo ), sì, ma in grado di stare in piedi se la rete globale – in larga parte nelle mani delle corporation della Silicon Valley in California, USA – collassasse per vari motivi.

Il terzo pilastro della sovranità telematica russa è l'obbligo di pre-installazione della superapp Max, nonché dell'utilizzo dell'ID incluso in essa nella fruizione di vari servizi pubblici.

Vado a riepilogare alcuni punti della mia ricerca, giusto un assaggio del lavoro complessivo.

2

Offro al lettore di passaggio qualche appunto dal Codice civile riformato negli anni recenti.

L'architettura legislativa dell'argomento discusso si fonda su tre pilastri principali :

● La Legge federale ''Sull'informazione, le tecnologie dell'informazione e la protezione delle informazioni'', N° 149-FZ del 27 luglio 2006 [1]: è il quadro normativo di riferimento che stabilisce i meccanismi per l'archiviazione locale dei dati degli utenti, l'obbligo di identificazione per i blogger, e i criteri generali per la censura preventiva, definendo le motivazioni per il blocco extra-giudiziale dei siti-web e l'oscuramento delle risorse ritenute ''estremiste'' e/o ''offensive'' per le istituzioni pubbliche.

● La Legge federale "Sulle modifiche alla legge federale "Sulla lotta al terrorismo" e ad alcuni atti legislativi della Federazione Russa in materia di adozione di misure aggiuntive per contrastare il terrorismo e garantire la sicurezza pubblica", N° 374-FZ del 6 luglio 2016 [2], parte del cosiddetto ''Pacchetto Jarovaja'' assieme alla Legge federale N° 375-FZ del 6 luglio 2016 { [3]... }, dal nome della co-firmataria Irina Jarovaja ( Ирина Анатольевна Яровая, trasl. spesso Yarovaya; deputata e vice-Presidente della Duma di Stato, del partito Russia Unita ), che di fatto agisce sulla censura dei contenuti obbligando gli operatori di telecomunicazioni a conservare i metadati e il contenuto delle comunicazioni degli utenti, e a fornire i codici di decifrazione al servizio federale della sicurezza interna ( FSB, ФСБ; erede di alcune funzioni del vecchio KGB, КГБ ), disponendo pene severe per i trasgressori { [4][5]... }.

● La Legge federale ''Sulle modifiche alla legge federale "Sulle comunicazioni" e alla legge federale "Sull'informazione, la tecnologia dell'informazione e la protezione dell'informazione'', N° 90-FZ del 1° maggio 2019, detta brevemente ''Legge sull'internet sovrano'' [6]: obbliga i provider nazionali a utilizzare sistemi di instradamento e filtraggio centralizzati ( in lingua inglese : deep packet inspection, DPI ) gestiti dall'autorità federale di regolamentazione ( RKN, РКН )[7];

agevola due azioni :

○ l'isolamento parziale della rete russa ( RuNet ) dal web globale ( World Wide Web, W3 oppure www );

○ il rallentamento fino al blocco delle piattaforme e social media stranieri ritenuti politicamente e fattualmente ''ostili'' alla Federazione Russa.

2.1

Alcune conseguenze pratiche.

Nel solo anno 2025, il governo russo ha bloccato la cifra record di 1,29 milioni di pagine-web e varie risorse online – cioè ha bloccato l'accesso semplice e diretto a tali pagine, siti, e app da browser e/o sistema operativo mobile sul territorio russo – registrando un incremento del 59% rispetto all'anno precedente.

Alcuni argomenti censurati [8]:

● droga, 229.300 pagine, +80%;

● LGBTQ+, 170.300, +269%;

● pedopornografia, 155.600, +131%;

● altro sui minori, 52.200, +60%;

● alcool, 18.700, +190%;

● tool illegali [9], 93.000, +1.235%.

I cittadini russi e i residenti non possono accedere semplicemente e direttamente ad alcuni dei principali canali di comunicazione globale, a causa del blocco o del forte rallentamento ( in gergo tecnico inglese : throttling ) agito dall'autorità [10][11]:

● Chat : Discord, Signal, Telegram, Viber, WhatsApp ...

● News : BBC, Deutsche Welle, The Moscow Times ... e altre testate giornalistiche internazionali oppure locali.

● Siti di video-sharing : Vimeo, YouTube ...

● Social network : Facebook, Instagram, X ...

2.2

Parallelamente al rallentamento e blocco sul territorio russo delle chat più popolari, lo Stato ha promosso e gradualmente sta imponendo in vari ambienti di studio e lavoro la superapp Max ( Макс; stilizzato anche MAX )[12][13] sviluppata dall'azienda Communications Platform, proprietaria del social net VK ( ВКонтакте, sigla : ВК; trasl. : VKontakte ){ ...[14][15][16]...[17]... }, sulla base della propria app di messaggeria ( accantonata ) e vario codice open source ( anche occidentale ), ed è disponibile per i sistemi mobile Android, iOS, HarmonyOS ( Huawei ), HyperOS ( Xiaomi ), e i sistemi desktop MacOS e Windows, anche come componente aggiuntivo dei browser { [18]... }.

Con il decreto governativo n. 2241-r del 19 agosto 2025 [19] che aggiorna la legge federale n. 425-FZ del 2 dicembre 2019 [20], dal 1° settembre ogni dispositivo venduto nella Federazione Russa deve avere pre-installata Max assieme ad altre applicazioni russe oppure prodotte nei Paesi membri dell'Unione economica eurasiatica ( UEE; Евразийский экономический союз, ЕАЭС ), l'unione economica tra Armenia, Bielorussia, Kazakistan, Kirghizistan e Russia ( altri Paesi sono osservatori ).

L'azienda VK ha dichiarato che nel marzo 2026 il numero di cittadini russi che hanno registrato il proprio account su Max ha raggiunto la quota di 100 milioni [21].

3

Nella Federazione Russa non è illegale il possesso e l'uso personale di un software VPN ( Virtual Private Network; trad. : rete virtuale privata )[22] che permette l'accesso al servizio di crittografia, ma sono proibite sia la reclamizzazione che l'uso per accedere ai servizi e siti-web occidentali che sono stati censurati dal governo, nonché la diffusione di informazioni non verificate sul conflitto.

Ma è ovvio che chi la usa vuole accedere a tali siti ... cito solo una legge di approvazione abbastanza recente :

● La Legge federale ''"Sulle modifiche al Codice della Federazione Russa in materia di reati amministrativi" e "Sulle modifiche al Codice della Federazione Russa in materia di reati amministrativi"'', N° 281-FZ del 31 luglio 2025 [23] ha implementato nuovi articoli e parti nel codice specifico ( KoAP )[24][25];

ha inserito l'Articolo 13.53 che colpisce con multe pecuniarie ( i valori sottostanti in euro sono calcolati al cambio vigente rublo=euro nel momento in cui ho scritto il post ) l'utilizzatore finale ( utente finale ) che aggira le limitazioni vigenti ''anche con l'utilizzo di strumenti hardware e software di accesso a risorse limitate'', ovvero le VPN e le varie tecnologie di offuscamento ( input, output ), per fruire di pagine e siti-web classificati dall'autorità come ''estremisti'' [26]:

○ l'utilizzatore finale è passibile di una multa da 3.000 a 5.000 ₽ = 59,60 €.

La legge ha inoltre integrato la Parte 18 ( часть 18 ) nell'Articolo 14.3, che colpisce specificatamente la pubblicità e la promozione delle VPN, stabilendo nuove soglie sanzionatorie per le diverse categorie [27]:

○ cittadini, da 50.000 a 80.000 ₽ = 953,54 €;

○ funzionari e dirigenti pubblici, da 80.000 a 150.000 ₽ = 1.787,88 €;

○ aziende, da 200.000 a 500.000 ₽ = 5959,60 €.

3.1

Il risultato ?

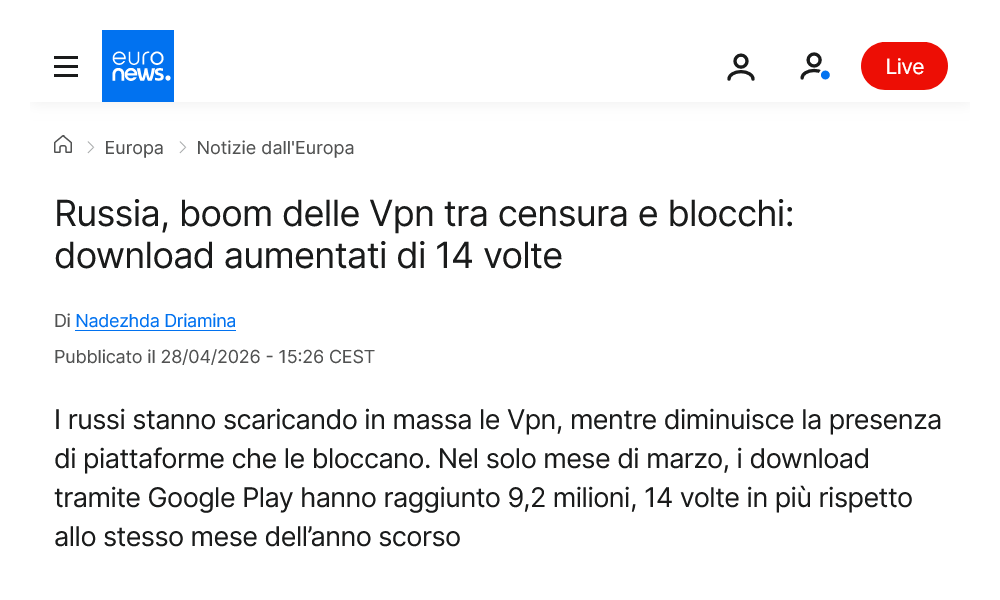

Sembra che i cittadini russi abbiano comunque scaricato e installato le VPN sui loro dispositivi :

Russia, boom delle Vpn tra censura e blocchi: download aumentati di 14 volte

I russi stanno scaricando in massa le Vpn, mentre diminuisce la presenza di piattaforme che le bloccano. Nel solo mese di marzo, i download tramite Google Play hanno raggiunto 9,2 milioni, 14 volte in più rispetto allo stesso mese dell’anno scorso

|

| [28] |

Conseguentemente, i burocrati hanno discusso dell'eventuale blocco integrale delle VPN, ma la cosa non sembra fattibile :

La Russia ammette che bloccare le VPN è impossibile

Un dirigente vicino al Cremlino ammette che vietare completamente le VPN potrebbe compromettere il funzionamento di banche, aziende e infrastrutture Internet russe.

|

| [29] |

3.2

All'inizio di aprile, il fotografo, scrittore, e organizzatore di viaggi Stefano Tiozzo, basato a Mosca ( Москва; vive nella capitale con la moglie russa-caucasica ), ha fatto una ''prova sul campo'' direttamente dalla Piazza Rossa ( Красная площадь )[30].

Consiglio la visione del video.

4

Conclusioni.

Premettendo che qualsiasi Paese in guerra adotta qualche forma di censura interna delle informazioni che arrivano dall'estero e dal fronte, e modifiche varie e straordinarie al codice civile e penale, pertanto gli strali degli ipocriti occidentali contro la ''censura russa'' sono malposti come spesso capita ai burattini di Bruxelles e dei vari governi nazionali; tanto più che il primo organismo a censurare la voce dell'altro, è stata proprio l'Unione Europea pochi giorni dopo il 24 febbraio 2022.

Sfogliando e leggendo le pagine citate sull'argomento, mi sono fatto una prima opinione personale : le misure restrittive sopraccitate mi sembrano finalizzate più a tratteggiare i profili psicologici degli utenti social con finalità di dossieraggio, che a punirli nell'immediatezza delle trasgressioni concretamente riscontrate, e tali rilievi possono essere usati successivamente per innescare oppure rafforzare accuse ben più pesanti e condizionanti, di carattere penale, con l'esito possibile ( e noto ) della vita in camerata e lavoro coatto.

Da un Paese di grande tradizione scacchistica, non mi meraviglia questa postura di attesa e studio.

Vedremo.

=

Note

[1] : ''Федеральный закон "Об информации, информационных технологиях и о защите информации" от 27.07.2006 N 149-ФЗ (последняя редакция)'' ( ''Legge federale "Sull'informazione, le tecnologie dell'informazione e la protezione delle informazioni" del 27 luglio 2006, n. 149-FZ (ultima revisione)'' ), КонсультантПлюс ( ConsultantPlus ), [ https://www.consultant.ru/document/cons_doc_LAW_61798/ ];

vedi anche : КонтурНорматив ( KonturNormativ ), [ https://normativ.kontur.ru/document?moduleId=1&documentId=504575 ].

[2] : ''Федеральный закон "О внесении изменений в Федеральный закон "О противодействии терроризму" и отдельные законодательные акты Российской Федерации в части установления дополнительных мер противодействия терроризму и обеспечения общественной безопасности" от 06.07.2016 N 374-ФЗ (последняя редакция)'' ( ''Legge federale "Sulle modifiche alla legge federale "Sulla lotta al terrorismo" e ad alcuni atti legislativi della Federazione Russa in materia di adozione di misure aggiuntive per contrastare il terrorismo e garantire la sicurezza pubblica" del 06.07.2016 N 374-FZ (ultima revisione)'' ), КонсультантПлюс ( ConsultantPlus ), [ https://www.consultant.ru/document/cons_doc_LAW_201078/ ];

vedi anche : КонтурНорматив ( KonturNormativ ), [ https://normativ.kontur.ru/document?moduleId=1&documentId=442797 ].

[3] : ''Федеральный закон "О внесении изменений в Уголовный кодекс Российской Федерации и Уголовно-процессуальный кодекс Российской Федерации в части установления дополнительных мер противодействия терроризму и обеспечения общественной безопасности" от 06.07.2016 N 375-ФЗ (последняя редакция)'' ( ''Legge federale "Sulle modifiche al Codice penale della Federazione Russa e al Codice di procedura penale della Federazione Russa in materia di istituzione di misure aggiuntive per contrastare il terrorismo e garantire la sicurezza pubblica" del 06.07.2016 N 375-FZ (ultima revisione)'' ), КонсультантПлюс ( ConsultantPlus ), [ https://www.consultant.ru/document/cons_doc_LAW_201087/ ];

vedi anche : КонтурНорматив ( KonturNormativ ), [ https://normativ.kontur.ru/document?moduleId=1&documentId=276448 ].

[4] : ''Закон Яровой'' ( ''Legge Jarovaja'' ), AA. VV., Wikipedia RUS, [ https://ru.wikipedia.org/w/index.php?title=%D0%97%D0%B0%D0%BA%D0%BE%D0%BD_%D0%AF%D1%80%D0%BE%D0%B2%D0%BE%D0%B9&oldid=152912288 ].

[5] : ''Russia Asks For The Impossible With Its New Surveillance Laws'', Danny O'Brien e Eva Galperin, Electronic Frontier Foundation ( EFF ), 19 luglio 2016, [ https://www.eff.org/deeplinks/2016/07/russia-asks-impossible-its-new-surveillance-laws ].

[6] : ''Федеральный закон "О внесении изменений в Федеральный закон "О связи" и Федеральный закон "Об информации, информационных технологиях и о защите информации" от 01.05.2019 N 90-ФЗ (последняя редакция)'' ( ''Legge federale "Sulle modifiche alla legge federale "Sulle comunicazioni" e alla legge federale "Sull'informazione, la tecnologia dell'informazione e la protezione dell'informazione" del 01.05.2019 N 90-FZ (ultima revisione)'' ), КонсультантПлюс ( ConsultantPlus ), [ https://www.consultant.ru/document/cons_doc_LAW_323815/ ];

vedi anche : КонтурНорматив ( KonturNormativ ), [ https://normativ.kontur.ru/document?moduleId=1&documentId=334782 ].

[7] : in lingua russa, Федеральная служба по надзору в сфере связи, информационных технологий и массовых коммуникаций, Роскомнадзор, trad. : Servizio federale per la supervisione delle comunicazioni, della tecnologia dell'informazione e dei mass media; sigla : РКН, trasl. : RKN;

sito-web : [ https://rkn.gov.ru/ ];

ConsultantPlus : [ https://www.consultant.ru/document/cons_doc_LAW_65443/d6a044bbd4117f73c5c0b1e43a3937dc12768631/ ];

Wiki RUS : [ https://ru.wikipedia.org/w/index.php?title=%D0%A0%D0%BE%D1%81%D0%BA%D0%BE%D0%BC%D0%BD%D0%B0%D0%B4%D0%B7%D0%BE%D1%80&oldid=152959014 ].

[8] : ''Russia Blocks Record 1.3M Web Pages in 2025'', The Moscow Times, 19 gennaio 2026, [ https://www.themoscowtimes.com/2026/01/19/russia-blocks-record-13m-web-pages-in-2025-a91719 ].

[9] : ad esempio, gli strumenti informatici utili a superare le restrizioni dell'RKN ( VPN, eccetera );

vedi : ''Роскомнадзор ограничил доступ к 469 VPN-сервисам'' ( ''Roskomnadzor ha limitato l'accesso a 469 servizi VPN'' ), РИА Новости ( RIA Novosti ), 26 febbraio 2026, [ https://ria.ru/20260226/roskomnadzor-2076790707.html ].

[10] : ''Russia: Digital Iron Curtain Falls on Internet Freedom Protection Day'', Human Rights Watch, 12 marzo 2026, [ https://www.hrw.org/news/2026/03/12/russia-digital-iron-curtain-falls-on-internet-freedom-protection-day ].

[11] : ''Эксперты: из базы DNS-серверов РКН убрали YouTube и Whatsapp ради разгрузки ТСПУ на другие задачи'' ( ''Esperti: YouTube e WhatsApp rimossi dal database del server DNS di Roskomnadzor per liberare il TSPU (Technical Support Unit) per altri compiti'' ), Хабр ( Khabr ), 12 febbraio 2026, [ https://habr.com/ru/news/995606/ ].

[12] : ''Max (app)'', AA. VV., Wikipedia ENG, [ https://en.wikipedia.org/w/index.php?title=Max_(app)&oldid=1354825446 ];

Wiki RUS : [ https://ru.wikipedia.org/w/index.php?title=%D0%9C%D0%B0%D0%BA%D1%81_(%D0%BC%D0%B5%D1%81%D1%81%D0%B5%D0%BD%D0%B4%D0%B6%D0%B5%D1%80)&oldid=153145417 ].

[13] : Max, sito-web, [ https://max.ru/ ];

GitHub : [ https://github.com/max-messenger ].

[14] : ''Названа организация, которая будет развивать мессенджер Max'' ( ''È stata individuata l'organizzazione che svilupperà l'applicazione di messaggistica Max'' ), РИА Новости ( RIA Novosti ), 15 luglio 2025, [ https://ria.ru/20250715/max-2029173724.html ].

[15] : ''Российский WeChat: что известно о мессенджере Max, который может заменить WhatsApp'' ( ''WeChat in Russia: cosa sappiamo di Max, l'app di messaggistica che potrebbe sostituire WhatsApp?'' ), Sergej Kagermazov e Svetlana Reiter, BBC, 21 luglio 2025, [ https://www.bbc.com/russian/articles/cn419l9k7wno ].

[16] : ''The Quiet Technocrat Who Enacts Putin’s Ruthless Agenda'', Anton Troianovski, The New York Times ( NYT ), 10 agosto 2025, [ https://www.nytimes.com/2025/08/10/world/europe/putin-russia-ukraine-war-sergei-kiriyenko.html ].

[17] : ''Kremlin Enters the Chat With Russia’s New Super-App'' ( ''Il Cremlino entra in gioco con la nuova super-app russa'' ), Matthew Luxmoore e Milàn Czerny, The Wall Street Journal ( WSJ ), 1° aprile 2026, [ https://www.wsj.com/world/russia/kremlin-enters-the-chat-with-russias-new-super-app-830c703a ].

[18] : ''Мессенджер MAX: как войти, скачать и пользоваться без установки'' ( ''MAX Messenger: come accedere, scaricare e utilizzare senza installazione'' ), vtemah, LiveJournal, 15 febbraio 2026, [ https://vtemah.livejournal.com/2733181.html ].

[19] : ''Распоряжение Правительства РФ от 19.08.2025 N 2241-р <Об утверждении перечня российских программ для электронных вычислительных машин, которые должны быть предварительно установлены на отдельные виды технически сложных товаров в 2026 году>'' ( ''Decreto del Governo della Federazione Russa del 19 agosto 2025 n. 2241-r <Sull'approvazione dell'elenco dei programmi russi per computer elettronici che devono essere preinstallati su determinate tipologie di beni tecnicamente complessi nel 2026>'' ), КонсультантПлюс ( ConsultantPlus ), [ https://www.consultant.ru/document/cons_doc_LAW_512661/ ];

vedi : ''I. Оборудование беспроводной связи для бытового использования [ ... ]'' ( ''I. Apparecchiature di comunicazione wireless per uso domestico [ ... ]'' ), КонсультантПлюс ( ConsultantPlus ), [ https://www.consultant.ru/document/cons_doc_LAW_512661/7f862bf0d9676cb2f47b8c793bcf6e3064deedfb/ ];

vedi anche : КонтурНорматив ( KonturNormativ ), [ https://normativ.kontur.ru/document?moduleId=1&documentId=501153 ].

[20] : ''Федеральный закон "О внесении изменения в статью 4 Закона Российской Федерации "О защите прав потребителей" от 02.12.2019 N 425-ФЗ (последняя редакция)'' ( ''Legge federale "Sulla modifica dell'articolo 4 della legge della Federazione Russa "Sulla tutela dei diritti dei consumatori" del 02.12.2019 N 425-FZ (ultima revisione)'' ), КонсультантПлюс ( ConsultantPlus ), [ https://www.consultant.ru/document/cons_doc_LAW_339102/ ];

vedi anche : КонтурНорматив ( KonturNormativ ), [ https://normativ.kontur.ru/document?moduleId=1&documentId=379645 ].

[21] : ''MAX messenger tops 100 mn registered users'', VK, 10 marzo 2026, [ https://vk.company/en/press/releases/12248/ ].

[22] : la VPN è una tecnologia che protegge la connessione internet e la privacy online creando un tunnel crittografato per i dati e nascondendo l'indirizzo IP reale, realizzando così un certo livello di sicurezza nell'uso delle reti Wi-Fi private e pubbliche;

vedi : ''VPN'', Neologismi, Vocabolario Treccani, 2021, [ https://www.treccani.it/vocabolario/vpn_(Neologismi)/ ].

[23] : ''Федеральный закон от 31.07.2025 N 281-ФЗ "О внесении изменений в Кодекс Российской Федерации об административных правонарушениях и Федеральный закон "О внесении изменений в Кодекс Российской Федерации об административных правонарушениях"'' ( ''Legge federale del 31 luglio 2025 n. 281-FZ "Sulle modifiche al Codice della Federazione Russa in materia di reati amministrativi" e Legge federale "Sulle modifiche al Codice della Federazione Russa in materia di reati amministrativi"'' ), КонсультантПлюс ( ConsultantPlus ), [ https://www.consultant.ru/document/cons_doc_LAW_511068/ ];

vedi anche : КонтурНорматив ( KonturNormativ ), [ https://normativ.kontur.ru/document?moduleId=1&documentId=500839 ].

[24] : in lingua russa, Кодекс Российской Федерации об административных правонарушениях, trad. : Codice della Federazione Russa sui reati amministrativi; sigla : КоАП РФ, trasl. : KoAP RF, brevemente KoAP;

sito-web : [ http://pravo.gov.ru/proxy/ips/?docbody&nd=102074277 ];

ConsultantPlus : [ https://www.consultant.ru/document/cons_doc_LAW_34661/ ];

KonturNormativ : [ https://normativ.kontur.ru/document?ModuleId=1&DocumentId=505981 ];

Wiki RUS : [ https://ru.wikipedia.org/w/index.php?title=%D0%9A%D0%BE%D0%B4%D0%B5%D0%BA%D1%81_%D0%A0%D0%BE%D1%81%D1%81%D0%B8%D0%B9%D1%81%D0%BA%D0%BE%D0%B9_%D0%A4%D0%B5%D0%B4%D0%B5%D1%80%D0%B0%D1%86%D0%B8%D0%B8_%D0%BE%D0%B1_%D0%B0%D0%B4%D0%BC%D0%B8%D0%BD%D0%B8%D1%81%D1%82%D1%80%D0%B0%D1%82%D0%B8%D0%B2%D0%BD%D1%8B%D1%85_%D0%BF%D1%80%D0%B0%D0%B2%D0%BE%D0%BD%D0%B0%D1%80%D1%83%D1%88%D0%B5%D0%BD%D0%B8%D1%8F%D1%85&oldid=152648028 ].

[25] : precedentemente, la Legge federale N° 78-FZ aveva revisionato l'Articolo 14.3 del KoAP inasprendo le sanzioni per la pubblicità illegale, raddoppiando le multe per lo spam telefonico ( fino a 1M rubli per le aziende ) e per la pubblicità ingannevole di prodotti finanziari.

[26] : ''Федеральный закон "О внесении изменений в Федеральный закон "Об информации, информационных технологиях и о защите информации" и Федеральный закон "О связи" от 31.07.2023 N 406-ФЗ (последняя редакция)'' ( ''Legge federale "Sulle modifiche alla legge federale "Sull'informazione, la tecnologia dell'informazione e la protezione dell'informazione" e alla legge federale "Sulle comunicazioni" del 31 luglio 2023 N 406-FZ (ultima revisione)'' ), КонсультантПлюс ( ConsultantPlus ), [ https://www.consultant.ru/document/cons_doc_LAW_453265/ ];

vedi anche : ''Усилена административная ответственность за отдельные правонарушения в сфере транспортно-экспедиционной деятельности, связи и информации'' ( ''La responsabilità amministrativa è stata inasprita per alcuni reati nel settore dei trasporti, delle spedizioni, delle comunicazioni e dell'informazione.'' ), КонсультантПлюс ( ConsultantPlus ), [ https://www.consultant.ru/law/hotdocs/90260.html ];

vedi anche : КонтурНорматив ( KonturNormativ ), [ https://normativ.kontur.ru/document?moduleId=1&documentId=453093 ].

[27] : fonte #23.

[28] : ''Russia, boom delle Vpn tra censura e blocchi: download aumentati di 14 volte'', Nadezhda Driamina, Euronews, 28 aprile 2026, [ https://it.euronews.com/my-europe/2026/04/28/russia-boom-delle-vpn-tra-censura-e-blocchi-download-aumentati-di-14-volte ].

[29] : ''La Russia ammette che bloccare le VPN è impossibile'', Michele Nasi, il Software, 14 maggio 2026, [ https://www.ilsoftware.it/russia-bloccare-vpn-impossibile/ ].

[30] : ''LA RUSSIA BLOCCA DEL TUTTO TELEGRAM E INTERNET E TORNA AL MEDIOEVO DIGITALE?'', Stefano Tiozzo, YouTube, 3 aprile 2026, [ https://www.youtube.com/watch?v=vnpNKIdj5Po ].

===

---

{ prima pubblicazione del post su VK, il 25 maggio 2026 [31] }.

|